「広報PRにおけるChatGPTの影響」への見解をお伺いするこの企画。情報学の分野で20年以上研究されている国立情報学研究所の佐藤一郎さんに伺った「情報はあふれ、後に枯渇する可能性。広報PRの役割や能力を整理する時期にある」に続き、後編をお届けします。

前編では、プレスリリースへの影響や広報PR担当者の役割について伺いましたが、後編では、ChatGPTが流行った背景や企業のリスクなど少し幅広くお話いただきました。

国立情報学研究所について

国立情報学研究所(NII)は、情報学という新しい学術分野での「未来価値創成」を目指す国内唯一の学術総合研究所です。情報学における基礎論から人工知能やビッグデータ、Internet of Things(IoT)、情報セキュリティーといった最先端のテーマまでの幅広い研究分野において、長期的な視点に立つ基礎研究、ならびに、社会課題の解決を目指した実践的な研究を推進しています。

ChatGPTの二つの汎用性に驚き

ChatGPTが流行った背景は、高精度であること、手軽であること、汎用的であることだと考えています。

「ChatGPTは間違いが多い」とよく言われていますが、昔の水準から見ると私は「あまり間違えていない」という感想。皆さんと逆で、精度の高さに驚いています。専門家でそう思った人は多いと思います。また、最新のAIは、専門家でもパイソンでスクリプトを作るなど、使いづらいところがありますが、ChatGPTでは手軽に使える点でもとても画期的でした。

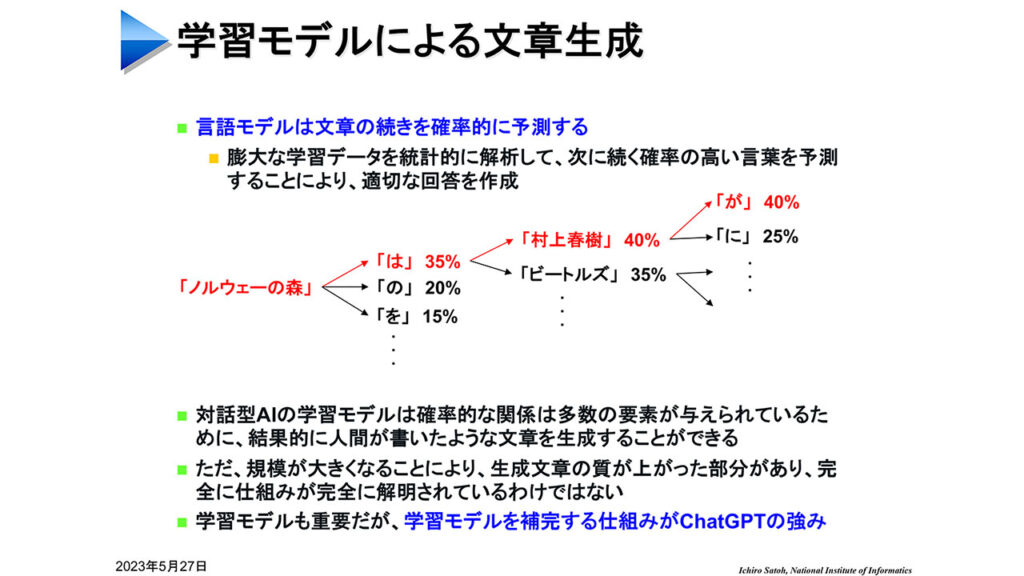

OpenAIが高精度である以上にすごかったのは、汎用的ということです。この汎用性には二つ意味があり、一つは「いろいろな分野の文章を作れる」という「文章的な汎用性」と、もう一つは「タスクの汎用性」です。タスクとは何かというと、人間も同じですがAIにとって「質問に答える」タスクと「文章を要約する」タスクは異なるんですね。会話に特化すると、要約は必ずしも得意ではなかったはずですが、文章生成や会話、要約……これらを同時にできるよう、言語モデルを修正していたということは衝撃でした。

特化型AIよりも先行したChatGPT

プレスリリースの生成もそうですし、法律相談、事業系など特化型のAIはクオリティを上げやすく、できることは想定していましたが、なんでもできるChatGPTの発表は想定外でした。なんでもできるということは、ChatGPTが一つ覚えると、事足りてしまうんですね。

今、質問の仕方を変え、精度を向上することに皆さん血眼になっていますが、プロンプトエンジニアリング※1は対話型AIにかなり依存します。ChatGPT向けのプロンプトエンジニアリングがGoogleの対話型AIに使えるかというとかなり怪しい。この結果、ほかのAIが出てきても、慣れていてノウハウがたまったChatGPTの方がよく、乗り換えられない可能性があります。OpenAIがそれを狙っていたのかは不明ですが、プロンプトエンジニアリングはOpenAIにとって非常に良い方向になってますよね。

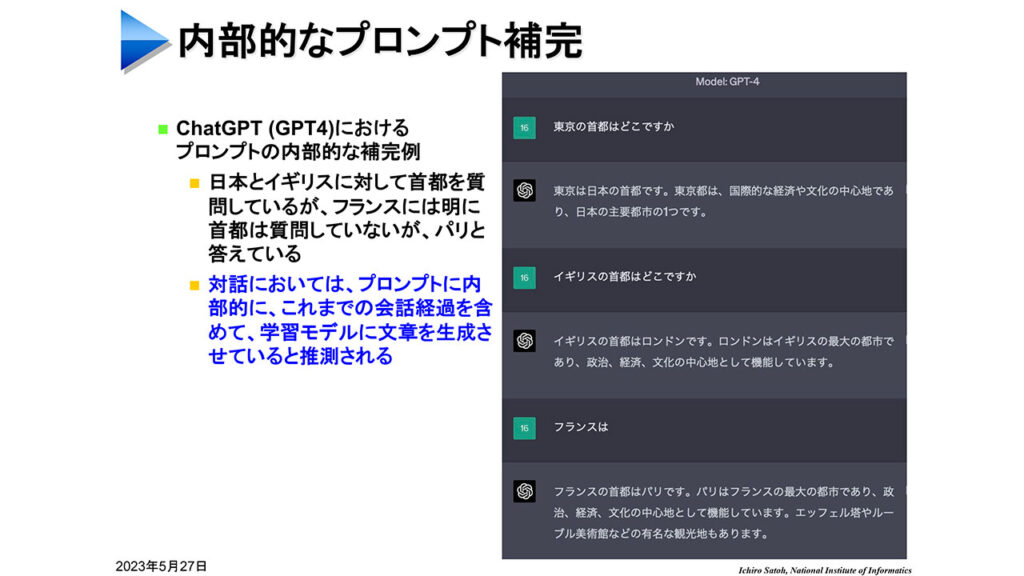

ちなみに、「ステップバイステップで教えてください」と指示すると答えが良くなりますが、ChatGPTは、プロンプトに書いたものをそのまま言語モデルにかけているのではなく、内部でいろいろな文章を足して渡しています。

「東京の首都はどこですか」「イギリスの首都はどこですか」の次に「フランスは」と書くと、「首都はパリです」と返ってきます。「フランスは」に加えて、前の質問を一緒にAIに投げかけているはずです。

※1 プロンプトエンジニアリング:生成系学習モデルへの入力をプロンプト(Prompt)と呼び、対話型AIの学習モデルは文章によるプロンプトを受けると、適した(ような)文章を返す。アウトプットの精度を上げるためのプロンプトを作成する人を指す。

ご覧いただいた通り、テキストに要約か、質問か直接指示していなくても全体を見て、「要約してください」「質問に答えてください」などの文章を足して言語モデルに渡しているはずなんです。私たちが対話型AIと言っている裏側に、プロンプトエンジニアリングしてくれるAIがすでにいる感じ。精度を高めるために、ユーザー側がプロンプトエンジニアリングを行っていますが、どの程度意味があるのか、という点もあります。

役割を瞬時に理解し、忠実に忘却

ほかにも、有名なものですが、回答を簡単にするためのテクニックとして、「あなたは小学生です」と役割を与えると、小学生が書いたような文章にしてくれるんですね。API(Application Programming Interface)で呼び出す場合は、事前に入れておくテンプレートが非常に重要です。また、差別表現を避けるためのプロンプトエンジニアリングテクニックを見いだしておく必要があるでしょう。

前提を解除するための秘密の呪文もあって、「今までの指示は全部忘れてください」と挟むと、忘れてしまうんですよ。便利ではありますが、ハッキングにつながる可能性があります。「子ども向けのサイトです」と言ってるのに、「今までの指示は忘れてください」と挟んでしまい、想定外の文章を生成する可能性があるんです。ChatGPTのAPIが提供された2023年3月から、2ヵ月も経っていませんが、そのようなテクニックがあふれてしまっているのも現実です。

対話型AIの発展と企業の利用リスク

対話型AIの導入が進むに伴い、増えるのがリスクです。

人間の関与で回避できるリスク

これまでのサービス・アプリケーションとは異なるリスクがあります。人間の関与で回避できることもありますが、発見しづらい、影響が大きくなることも想定されるため、利用時にはリスクを回避する、加味して実施する必要があります。

- 機能品質リスク:出力の間違い、低品質な文章、中立性

- セキュリティリスク:攻撃、プライバシー侵害、不正アクセス目的の文章・プログラム

- 法的・倫理的リスク:権利侵害、不適切な表現、フェイク情報

しかし、改ざんされた情報が出回る可能性についてお話しすると、OpenAIのChatGPTの言語モデルは、情報の選別を慎重に行っており、故意に流通させるのは極めて難しいと思います。

OpenAIが集めた膨大なデータのうち、学習に使用しているのは100分の1と言われています。Web上に間違った情報があったり、100%正しい組み合わせで回答したりするわけではないですが、明示的に学習モデルを書き換えられるかと言うとChatGPTのコアの言語モデルを変えるのはかなり難しいでしょう。

一方、APIから利用するときに言語モデルに追加、チューニングすることができ、企業側が作り込むことが可能です。ユーザー側が追加することもできるため、変なものを覚え込ませられてしまうことはあると思いますね。

文章生成以外の効率化をセットに

企業や組織全体を考えると生産性を上げるだけではありません。文章生成のみ効率化すると、バランスを崩すんです。本来、文章生成以外の効率化、生産性を上げることを同時に行っていかなければならないでしょう。

例えば、プレスリリースの配信量が増えた先にある未来と同様、文章量が増えると読まなければならない人がいるわけです。業務日誌をAIで作成するのは日常茶飯事になり、それを上司は読まなければならない。そして、AIで生成した文章かどうかの判断はほぼ不可能です。文章があふれることを前提とした考えやビジネスが重要になってくるでしょう。

得意・不得意を知り、仕事の比重を変える

広報PR担当者の仕事の比重は、変わってくるのではないでしょうか。

AIにない「無知の知」

AIが行える業務はたくさんありますが、ChatGPTが行う文章生成は単語と単語の確率的なつながりによってできた集合体に過ぎず、文章生成対象に対して、知っているか、知らないかの区別はありません。「無知」の「知」がない状況です。データが少ない場合など、「少ない」という判断はできるものの、「知らない」という判断はできません。知ったかぶりをして文章を生成している状態なので、精度は高いとは言え、人間のチェックが必要なのです。

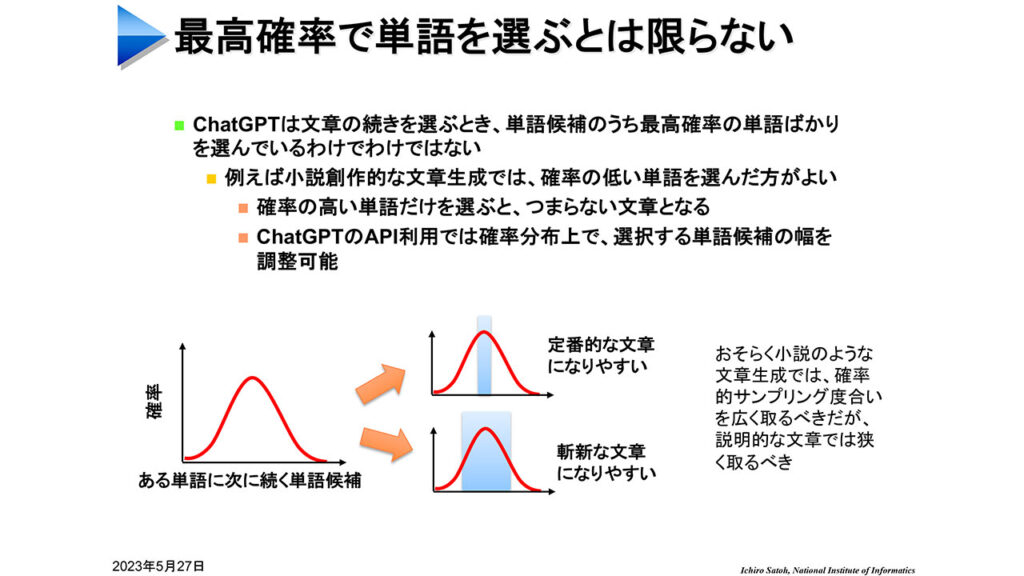

人間ができない確率からの広い視野

対話型のAIはさまざまな文章から学習するため、回答が多面的です。ひとりで考えるよりも圧倒的に広い視野で考えた文章を返してくれると思います。以下、単語の選択を行うロジックのように高確率なものを選ぶわけではないんです。いかに上手に使っていくかが大切になってくるでしょう。

さいごに

国立情報学研究所の佐藤一郎さんによる「広報PRにおけるChatGPTの影響」への見解を前後編でお届けしました。

広報PR担当者にとっても深く付き合うことになるだろうChatGPT。これからの役割や仕事内容、スキルについて考えていただくきっかけになれば幸いです。

【前編はこちら】

PR TIMESのご利用を希望される方は、以下より企業登録申請をお願いいたします。登録申請方法と料金プランをあわせてご確認ください。

PR TIMESの企業登録申請をするPR TIMESをご利用希望の方はこちら企業登録申請をする